26-27 февраля 2019 года в Хельсинки (Финляндия) прошла Конференция высокого уровня Совета Европы «Governing the Game Changer» — влияние развития искусственного интеллекта (ИИ) на права человека, демократию и верховенство права. В ней участвовали представители 47 стран.

Участник конференции от России профессор Максим Фёдоров – директор «Центра Сколтеха» по научным и инженерным вычислительным технологиям для задач с большими массивами данных – определяет ИИ словами «анализ [данных], решение, действие». Система, способная самостоятельно принимать решения извлечь информацию из данных, принять на основе этой информации решение и осуществить его – это ИИ-система.

Участники конференции (представители госструктур, науки, гражданского общества и др. организаций) зафиксировали, что скоординированные действия на глобальном уровне абсолютно необходимы для создания атмосферы доверия и подотчётности в отношении развития и применения ИИ в целях максимального использования его потенциала в интересах общества, мира и процветания, а также для предотвращения любого использования всевозможных ИИ-технологий в ущерб прав человека и сложившихся демократических систем. Проведены обсуждения, в которых участвовали специалисты в области права, судебной системы и юриспруденции, развития информационного общества, защиты данных и киберпреступности, культуры, биоэтики, образования, гендерного равенства.

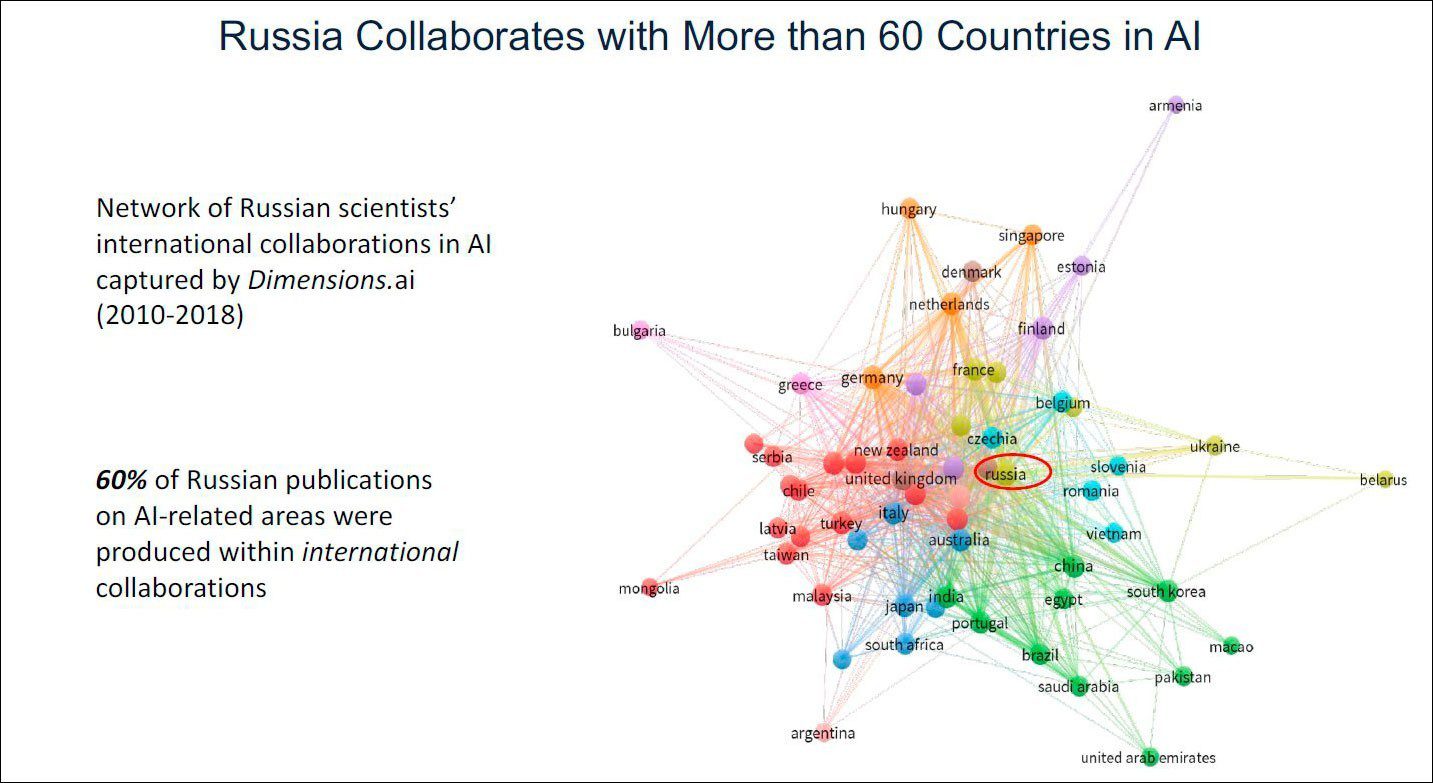

Выступление Максима Фёдорова, представлявшего Россию, содержало важные сведения об участии отечественных специалистов в международной кооперации с европейскими (и не только) исследователями ИИ.

Фёдоров напомнил также в связи с ИИ об учении Вернадского о ноосфере – оно сохраняет продуктивность при решении гуманитарных проблем, порождаемых ИИ.

Присутствие представителей крупных международных промышленных ИКТ-корпораций и частных компаний было минимальным. Наиболее крупной компанией, имеющей свой стенд на выставке конференции, была Microsoft. Из российских компаний в выставке участвовала Pravoved.ru (IT-компания, резидент «Сколково» – юридический онлайн-сервис на основе обучаемой нейронной сети, первый в России робот-юрист).

Изучение материалов конференции и свидетельства её российских участников приводят к выводу, что де факто в Европе ИИ-системами считается всё, что действует «как человек» и способно заменить человека на рабочем месте – например, в таких областях, как правосудие, бухгалтерия, управление транспортом и др. Например, использование роботов-судей в Хельсинки обсуждалось как насущная задача – мелкие гражданские дела вроде присуждения штрафа за неверную парковку можно отдать на решение ИИ-системе, полагали некоторые эксперты, это избавит суды от рутины, а вероятность судебной ошибки при таком подходе минимальна.

Благополучную развитую Европу, привыкшую к жизни по веками совершенствовавшимся, устоявшимся правилам, более всего заботит, как сохранить статус-кво в обстановке, быстро меняющейся под давлением новых технологий, в частности, ИИ. «Жить по-старому в новых условиях» – негласный девиз Евросоюза. Подтверждают это не только материалы и впечатления участников конференции в Хельсинки, но и то, например, что государственное финансирование ИИ-исследований в ЕС гораздо скромнее того, что тратят на ИИ США и Китай», — говорит Максим Фёдоров.

Видна общая тенденция пассивного отношения к информационным технологиям – так, у ЕС, в отличие от Китая и России, нет собственной поисковой машины, а отдельные страны даже ведут дипломатическую работу с транснациональными IT-компаниями – так, будто они равноправные партнёры государств.

Европейский подход существенно отличается от стратегий КНР и США в отношении ИИ, стремящихся прежде всего к развитию технологий.

Итог конференции

В итоговом документе конференции («Итоговые заключения») отмечены следующие положения и рекомендации:

1. ИИ позитивно и негативно сказывается на осуществлении прав человека, функционировании демократических обществ и верховенстве права. ИИ требует своевременных и продуманных политических мер реагирования со стороны правительств.

2. ИИ обладает значительным потенциалом для экономического роста и инноваций. Эти цели, по сути, лежат в основе общих ценностей демократических обществ. Экономические выгоды, получаемые от ИИ, не могут быть реализованы без должного уважения этих демократических ценностей.

3. ИИ затрагивает все аспекты человеческой жизни во всех её проявлениях. Все государства и заинтересованные стороны («стейкхолдеры») должны координировать свои усилия и, в частности, обмениваться информацией и передовыми практиками.

4. ИИ должен разрабатываться с учётом интересов человека, чтобы приносить пользу как отдельным людям, так и обществу в целом. Прозрачная и подотчётная оценка (экспертиза) целесообразности применения ИИ в конкретном прикладном контексте, оценка всех рисков и преимуществ должна проводиться на протяжении всего жизненного цикла развития технологии.

5. Важно выработать чёткое понимание ИИ и его воздействия на права человека, демократию и верховенство права. Это требует инвестиций в междисциплинарные и независимые исследования, направленные на изучение прямого и косвенного воздействия ИИ на отдельного человека и общество в целом в конкретных контекстах.

6. Должны быть созданы эффективные надзорные механизмы и демократические контрольные (наблюдательные) структуры по вопросам проектирования, разработки и внедрения ИИ.

7. Демократические процессы должны предполагать существование независимой, информированной общественности, а также поощрять открытые и инклюзивные дискуссии. Необходимо повышать осведомлённость общества о потенциальных рисках и преимуществах ИИ, развивать новые компетенции и навыки.

8. Права человека являются основной ценностью демократических обществ, их защита и распространение требует активного участия всех заинтересованных сторон, уделяя при этом особое внимание потребностям уязвимых групп, которые могут столкнуться с маргинализацией. Необходимы эффективные и легитимные механизмы для предотвращения нарушений прав человека, дискриминации, неравенства и предрассудков.

9. Разработка, развитие и внедрение инструментов ИИ должны быть предметом оценки рисков. Все автоматизированные процессы должны быть разработаны таким образом, чтобы они были тщательно изучены человеком. Алгоритмическая прозрачность имеет решающее значение в вопросе укрепления доверия и обеспечения надлежащей защиты прав.

10. Алгоритмические расчёты не должны ставить под угрозу равенство перед законом. Инструменты ИИ могут помочь подготовленным судьям, в то время как содержание и контуры законов и правовых систем демократических обществ должны оставаться под авторитетным управлением людей.

11. Существующие основополагающие международные инструменты, включая Всеобщую декларацию прав человека и Европейскую конвенцию о защите прав человека и основных свобод, применимы независимо от контекстуальных изменений, вызванных ИИ.

12. Все заинтересованные стороны должны принять участие в углубленном изучении и исследовании воздействия ИИ на права человека, демократию и верховенство закона. Совет Европы, применяя многосторонний подход, должен продолжать, с учётом специфики каждого конкретного сектора, развивать рекомендации, руководства и кодексы поведения, направленные на поощрение защиты прав человека, и жизнеспособность демократических институтов и процессов. Следует осуществлять мониторинг воздействия ИИ на общественные основы демократических обществ.

Этические проблемы применения ИИ-систем столь серьёзны, что Институт инженеров электротехники и электроники (Institute of Electrical and Electronics Engineers, IEEE), авторитетная организация, объединяющая независимых экспертов, посвятила этой проблеме обширный, на 250+ страниц, документ «Ethically Aligned Design: A Vision for Prioritizing Human Well-being with Autonomous and Intelligent Systems» («Этически обусловленная разработка: представление о главенстве благополучия человека в связи с автономными и интеллектуальными системами») и ещё несколько дополнительных рекомендаций.

Например, использование ИИ-систем в качестве судей по гражданским делам исключает совершенствование работы судов. Обученный на прецедентах судебных решений робот, напротив, укрепит существующую практику, даже если та была порочной – вследствие, как вариант, коррупции. ИИ-системы с высокой вероятностью прервут естественную эволюцию права в направлении справедливого разрешения противоречий, возникающих между людьми. В суде, где решения принимает техническая система, Фёдор Плевако ни при каких условиях не сможет выиграть классическое дело старушки, укравшей чайник: апеллировать к чувству справедливости робота невозможно.

ИИ несёт угрозу демократическим процедурам, что продемонстрировала история Cambridge Analytica. Эта угроза особенно актуальна для ЕС, стремящегося к сохранению существующих процедур принятия общественных решений и управления социумом.

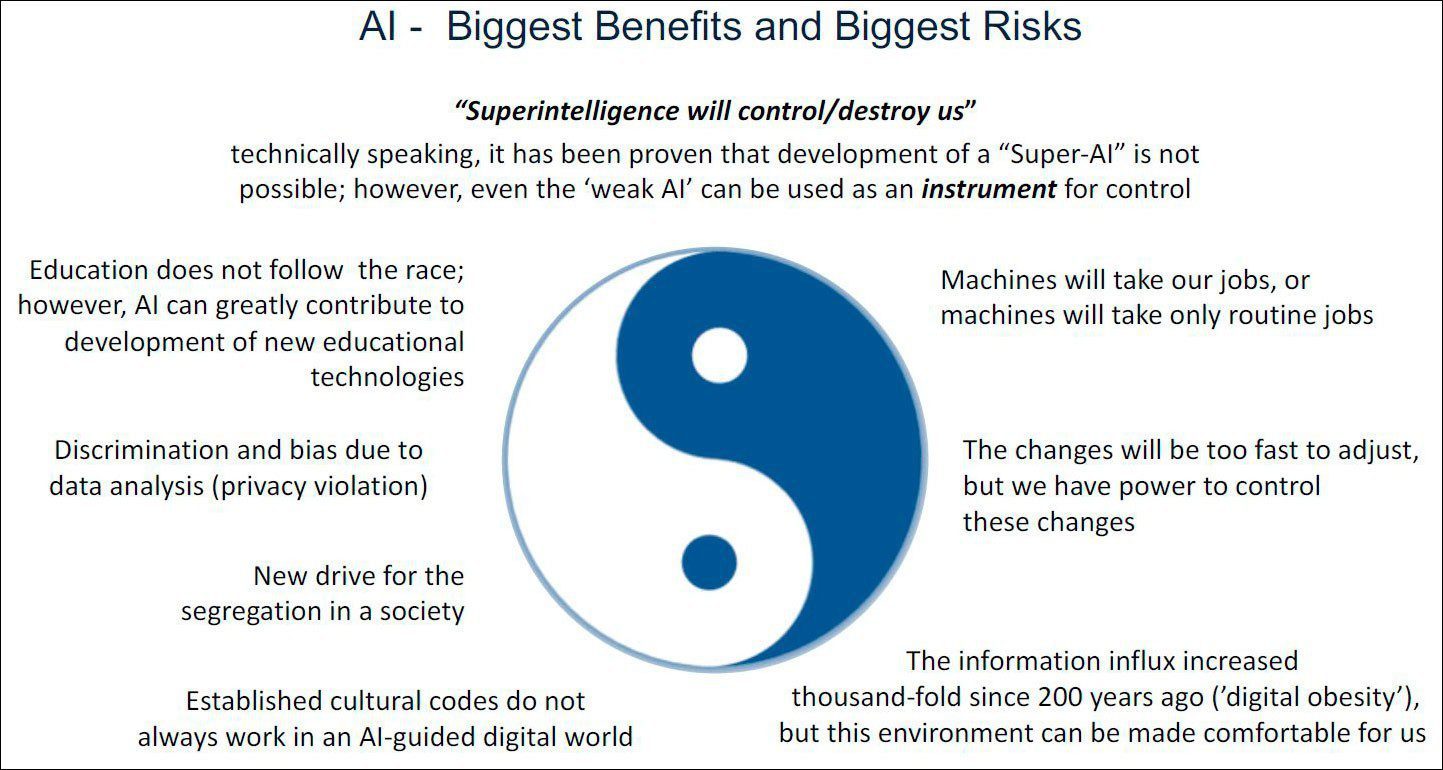

И основное: существует вероятность, что ИИ-системы непоправимо изменят условия, в которых до сих пор эволюционировал homo sapiens. Как следствие, люди рискуют деградировать умственно и эмоционально и, утратив основное эволюционное преимущество, исчезнуть как биологический вид. Это маловероятно, однако возможно – вследствие радикального ускорения изменений в ноосфере, её необратимой цифровизации. Даже при сохранении человечества как биологического вида может наступить цифровое средневековье – без тайны частной жизни, без примата нравственности, без человека как меры вещей.

Единственное средство обезопасить ИИ – антропоцентризм. Исключить непрозрачность – первое требование безопасности ИИ-систем.

ИИ должен стать прозрачной инфраструктурой, обслуживающей общественные интересы, и контролируемой людьми уже отлаженными методами – сертификация (как ИИ-систем, так и специалистов), обеспечение надёжности. Максим Фёдоров проводит аналогию с авиацией – потенциально опасная, сложнейшая техническая система планетарного масштаба работает с достаточной надёжностью, обеспечивая одновременно и очевидные экономические выгоды, и безопасность людей.